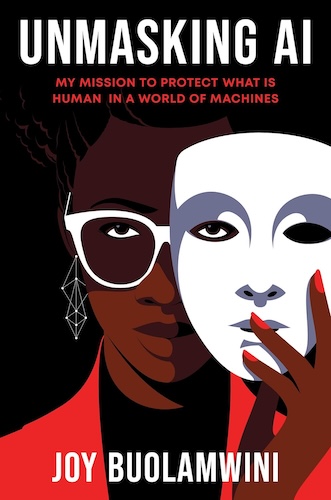

Joy Buolamwini著「Unmasking AI: My Mission to Protect What Is Human in a World of Machines」

黒人女性の人工知能(AI)研究者で「コードの詩人」を名乗りアルゴリズムによる差別と闘う団体「アルゴリズミック・ジャスティス・リーグ」創始者の本。著者は顔認識アルゴリズムを使った実験をしていたところ濃い色の肌をした自分の顔がコンピュータによって認識されず、パーティでもらった白い顔マスクをしたところ認識された経験から気づきを得て、AIがその元となった学習データに内包された社会的な偏見や格差を増幅させたり、警察や福祉行政によって差別的に運用される危険について取り組んでいる。

本書では、はじめは技術者として「人種や性別に関わらず使えるより高性能なAI」の実現を目指して黒人や女性などを学習データに含めるようにと考えていた著者が、「Weapons of Math Destruction: How Big Data Increases Inequality and Threatens Democracy」(邦題『あなたを支配し、社会を破壊する、AI・ビッグデータの罠』)著者のCathy O’Neilや「Race After Technology: Abolitionist Tools for the New Jim Code」のRuha Benjamin、「Design Justice: Community-Led Practices to Build the Worlds We Need」のSasha Constanza-Chockらとの交流を通して「AIに認識されない(誤認識される)ことによる問題」とともに「AIによって認識されることによって生じる問題」の存在に気づき、技術そのものではなくそれが使われる社会的環境や、誰がどういう目的でその技術を運用するのかという部分にまで視野を広げた経緯が書かれている。

たとえば犯罪捜査のために顔認識システムが採用されたとして、システム構築に使われた学習データに黒人のサンプルが少ないために黒人を対象とした際の認識精度が低く、まったく別の黒人が容疑者として逮捕されるという事態は既に起きているが、仮にそれが是正されたとしても、たとえば人種差別的な取り締まりのせいで過去に犯罪逮捕率が高かったからという理由で黒人の住んでいる地域にばかり監視カメラが設置され人々の生活に対する監視がさらに厳しくなったり、同じく人種差別的な過去の取り締まりのデータを元として再犯の危険性を予測するシステムが黒人容疑者に厳しい刑期や保釈不認可を推奨するという問題は解決されない。そうした危険に対処するには、司法や福祉など人々の生活に大きな影響を与える場面でのAIの採用には慎重になるべきだし、どのようなシステムがどう運用されるのか透明性と市民による意思決定への参加が保証されなければいけない。